Make: Ogaki Meetingに行ってきました。

会場では信長候がお出迎え。

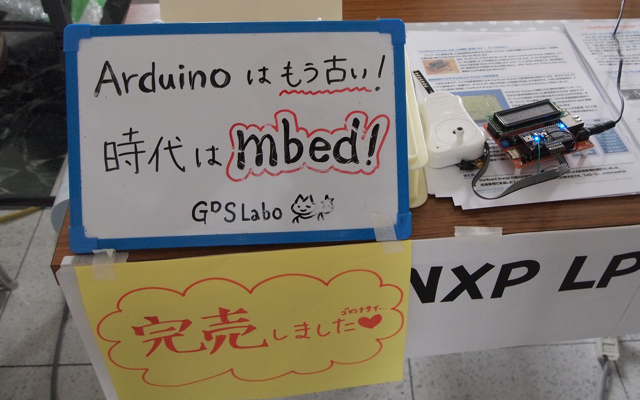

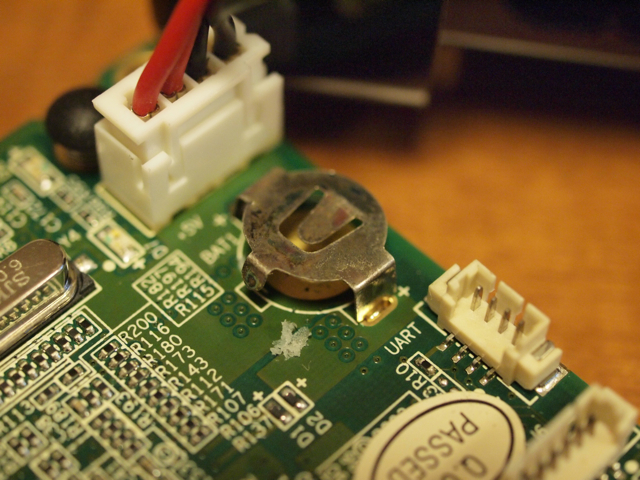

さっそく、GPS Laboさんのブースでご挨拶して、@logic_starさんに私の☆Board OrangeとP.O.V.をお見せしました。折角の☆Board Orangeの機能は使っていなかったので、回転速度とかをLCDに表示すればよかったと後から思いました。

Make:の会場はこじんまりとしていて回るのは楽でした。子供に受けたのはユビキダスブースにあった「居合切り」とか「野菜切り」でした。他にもいろいろありましたが、他のかたがたくさんレポートしていると思いますのでここでは省略。

私はFPGA-CAFEさんで、レーザースピログラフのキットを購入してしまいました。ちょっと危ないけど面白そう。週末に実験してみたいと思います。オライリーの300円ガチャポンでは見事に缶バッチが3つ当たりました。(はずれ?)

帰りにGPS Laboさんに寄ったら、☆Board Orangeは完売とのことでした。

次回のMake:で☆Board Orangeがどのくらいの使われているか楽しみです。

コメント